Rapports sur les projets spéciaux sur les entreprises

Un système à code source ouvert pour l’estimation de la hauteur des bâtiments au moyen d'images prises à partir de la rue, de l'apprentissage profond et d'empreintes d'immeubles

Consulter la version la plus récente.

Consulter la version la plus récente.

Information archivée dans le Web

L’information dont il est indiqué qu’elle est archivée est fournie à des fins de référence, de recherche ou de tenue de documents. Elle n’est pas assujettie aux normes Web du gouvernement du Canada et elle n’a pas été modifiée ou mise à jour depuis son archivage. Pour obtenir cette information dans un autre format, veuillez communiquer avec nous.

Remerciements

L’auteur de l’article tient à remercier Alessandro Alasia pour son précieux soutien, son aide et ses commentaires. L’auteur aimerait également remercier le Conseil de la R‑D de Statistique Canada qui a financé le présent projet.

Résumé

Depuis quelque temps, l’industrie et le milieu universitaire réfléchissent de plus en plus au déploiement d'images prises à partir de la rue pour en extraire de l’information. Plusieurs initiatives d’extraction de renseignements applicables dans diverses situations au moyen d’images prises à partir de la rue ont été réalisées. Il s'agissait notamment de détecter des trottoirs dans les villes pour aider les urbanistes et faciliter la classification des instances de bâtiments. La hauteur des bâtiments est un élément d’information important qui peut être extrait des images prises à partir de la rue. Ces renseignements primordiaux ont diverses applications importantes, par exemple dans les analyses économiques et l’élaboration de cartes tridimensionnelles des villes. Dans le cadre du projet, un système à code source ouvert est mis au point afin d’estimer automatiquement la hauteur des bâtiments au moyen d’images prises à partir de la rue, de l’apprentissage profond (AP), de techniques avancées de traitement des images et de données géospatiales. De nos jours, les images prises à partir de la rue et les données géospatiales nécessaires sont omniprésentes et disponibles sur de nombreuses plateformes. Le système a été conçu afin de servir, ultimement, à enrichir la Base de données ouvertes sur les immeubles (BDOI), qui a été publiée par Statistique Canada, dans le cadre de l'Environnement de couplage de données ouvertes (ECDO). Le présent article explique le système mis au point. Il présente en outre certains résultats obtenus en matière d’estimation de la hauteur des bâtiments. Certains cas difficiles et l’extensibilité du système sont également abordés.

1 Introduction

La hauteur des bâtiments est une donnée importante, car elle permet d’améliorer l’analyse économique de l’empreinte d’immeubles (en deux dimensions), qui peut servir à analyser le développement urbain et les processus d’urbanisation, ou à calculer des indicateurs socioéconomiques clés sur les espaces habitables ou les espaces de commerce de détail. Elle peut également être utilisée dans l’élaboration de cartes tridimensionnelles des villes.

Différentes technologies ont déjà été utilisées dans l’estimation de la hauteur des bâtiments, notamment les données de détection et télémétrie par ondes lumineuses (lidar) (Sampath et coll., 2010), ainsi que celles de radar à synthèse d’ouverture (RSO) (Brunner et coll., 2010). Le lidar est une technologie de télémétrie fondée sur le laser (Sampath et coll., 2010). Dans cette technologie, la lumière laser illumine la cible et sa réflexion est mesurée par un capteur. On réalise les représentations en 3D de la zone ou des objets d’intérêt en mesurant les différences du temps de retour du laser et des longueurs d’onde. La technologie de RSO est une technologie radar qui est utilisée pour les reconstitutions tridimensionnelles d’objets ou de paysages. Elle permet d'obtenir une résolution spatiale fine par le mouvement de l’antenne radar au-dessus de l’objet ou de la région d’intérêt. Le problème des méthodes susmentionnées est le coût élevé de l’obtention des données, ce qui rend infaisable leur utilisation à grande échelle.

Les images prises à partir de la rue sous licence libre sont de plus en plus répandues. Depuis quelques années, plusieurs plateformes d’images prises à partir de la rue sont apparues; elles proposent différentes modalités de services et des degrés variés de libre accès. Google Street View (Google, 2020), Mapillary (Mapillary, 2014) et OpenStreetCam (Grab Holdings, 2009) en sont des exemples. Ces images offrent des possibilités remarquables d’enrichir les données sur les bâtiments par des renseignements complémentaires pertinents permettant d’autres analyses économiques et spatiales. De plus, elles sont utilisables à grande échelle, car elles sont largement disponibles et facilement accessibles.

On trouve dans la littérature des initiatives d’extraction de données à partir d’images prises à partir de la rue. Elles comprenaient différentes applications, comme l’estimation de la composition démographique de quartiers aux États-Unis (Gebru et coll., 2017) ou la classification des instances de bâtiments (Kang et coll., 2018). Les résultats des travaux cités montrent que les images prises à partir de la rue peuvent effectivement constituer une riche source d’information dans de multiples applications.

La littérature rapporte les résultats de certains travaux utilisant des images de rue pour estimer la hauteur des bâtiments (Díaz et coll., 2016; Yuan et coll., 2016; Zhao et coll., 2019). Comme il a été mentionné précédemment, la disponibilité de ce type d’images permet une mise en œuvre à grande échelle. Une partie des travaux cités plus haut utilise des images prises à partir de la rue, tandis que d’autres utilisent des images prises à partir de la rue conjuguées à des données spatiales sur les bâtiments qui peuvent être obtenues à partir de cartes bidimensionnelles.

Dans le présent article, un algorithme d’estimation de la hauteur des bâtiments est proposé. L’approche est appelée Estimation de la hauteur des bâtiments à l’aide de l’apprentissage profond (AP) et du traitement des contours (EHBPC). L’EHBPC utilise des réseaux neuronaux convolutifs (RNC) pour détecter les bâtiments dans les images prises à partir de la rue. Ensuite, les dimensions du bâtiment dans l’image sont extraites au moyen de plusieurs techniques de traitement d’image. La hauteur du bâtiment est ensuite mesurée à partir de l’information extraite et d’autres renseignements spatiaux (coins du bâtiment, position de la caméra, etc.). La méthode proposée a été entièrement mise en œuvre au moyen du langage de programmation Python ainsi que d’images et de données provenant de sources ouvertes. Les résultats montrent que la méthode peut servir à estimer précisément la hauteur des bâtiments à partir d’images prises à partir de la rue.

L’approche vise à utiliser le système mis au point pour enrichir les empreintes d’immeubles bidimensionnelles par des données sur la hauteur des bâtiments. En 2019, Statistique Canada a publié la Base de données ouvertes sur les immeubles (BDOI) (Statistique Canada, 2019a) dans le cadre de l'Environnement de couplage de données ouvertes (ECDO), une initiative visant à fournir des microdonnées ouvertes de sources municipales et provinciales (Statistique Canada, 2019b). Une première version de la BDOI a été suivie d’une deuxième version publiée en collaboration avec Microsoft, qui a donné lieu à la première cartographie de presque toutes les empreintes d'immeubles du Canada. Cette base de données ouvertes en 2D est maintenant améliorable par l’ajout d’attributs aux empreintes d’immeubles; or la hauteur des immeubles est un des renseignements les plus pertinents. C’est pourquoi en 2020, Statistique Canada a lancé ce projet de R-D visant à étudier l’utilisation des images de rues dans l’estimation de la hauteur des bâtiments.

L’article présente en détail l’EHBPC et sa mise en œuvre. Le plan de l’article est le suivant. La section 2 passe en revue la littérature traitant du sujet. La section 3 présente l’EHBPC et traite de la détection des immeubles et de l’extraction de leurs dimensions. La section 4 examine l’extraction de l’information nécessaire à partir des données sur les empreintes d’immeubles. La section 5 présente le modèle de projection de la caméra utilisé aux fins d’estimation de la hauteur des bâtiments. La section 6 traite des résultats obtenus et de l’extensibilité du système, et la section 7 comporte la conclusion et des éléments que devront examiner de futurs travaux

2 Contexte et travaux sur le sujet

Comme on l’a vu précédemment, les images prises à partir de la rue ont déjà servi à l’extraction de données dans plusieurs applications. Dans (Smith et coll., 2013), des techniques d’apprentissage automatique et de vision par ordinateur ont servi à extraire des renseignements sur la présence et la qualité des trottoirs dans des villes. Des caractéristiques locales et mondiales – y compris le contexte géométrique, la présence de voies et la couleur des pixels – ont été utilisées avec le classificateur par forêts d'arbres décisionnels (ou forêts aléatoires) aux fins de détermination de segments de trottoir dans les images prises à partir de la rue. Les résultats montrent que la méthode proposée peut servir à efficacement cartographier et classer les trottoirs des images prises à partir de la rue, et ainsi aider les urbanistes à mettre en place des villes durables et conviviales pour les piétons.

Dans (Kang et coll., 2018), un cadre de classification des fonctionnalités de chaque bâtiment a été proposé. La méthode proposée classe les structures de façade à partir d’une combinaison d’images prises à partir de la rue et d’images de télédétection utilisant des réseaux neuronaux convolutifs. De plus, un ensemble de données de référence a été créé et utilisé afin d’entraîner et évaluer l’utilisation des RNC aux fins de classification des bâtiments.

Dans (Lichao Mou, 2018), les auteurs abordent le problème de l’estimation de la hauteur à partir d’une seule image monoculaire de télédétection. Une architecture de réseau convolutif-déconvolutif a été proposée et entraînée de bout en bout, ce qui comprenait un apprentissage résiduel, pour la modélisation de la cartographie ambiguë entre les images de télédétection monoculaires et les cartes de hauteurs. Le réseau se compose d’un sous-réseau convolutif et d’un sous-réseau déconvolutif, où la première partie extrait la représentation des caractéristiques multidimensionnelles et la seconde partie utilise la caractéristique extraite pour générer la carte des hauteurs. Un ensemble de données d’images aériennes à haute résolution couvrant une partie de Berlin a servi à entraîner et tester l’architecture proposée. Il est certain que cette méthode est applicable, mais on ne dispose pas toujours d’images de télédétection sous la forme de données ouvertes à grande échelle et pour toutes les zones.

Des travaux ont cherché à utiliser des images prises à partir de la rue pour estimer la hauteur des bâtiments. Dans (Díaz et coll., 2016), un algorithme est élaboré afin d’acquérir des milliers d’images géoréférencées de Google Street View à l’aide d’un système de transfert d’état représentationnel et d’estimer la hauteur moyenne par métrologie à vue unique. Les résultats montrent que l’algorithme proposé peut estimer précisément une carte de la hauteur moyenne des bâtiments de milliers d’images tirées de Google Street View. Un algorithme de ce type permet l’estimation exacte de la hauteur moyenne des bâtiments, mais il faut pouvoir estimer celle de chaque bâtiment.

Dans (Yuan et coll., 2016), il est proposé qu’une méthode d'intégration des empreintes d’immeubles à partir de cartes bidimensionnelles et d’images au niveau de la rue serve à estimer la hauteur des bâtiments. Les coordonnées géographiques bidimensionnelles sont obtenues à partir des empreintes d’immeubles. L’approche dans (Yuan et coll., 2016) est mise en œuvre par l’établissement de l’élévation de l’empreinte du bâtiment au niveau du sol, ce qui donne les coordonnées universelles tridimensionnelles. La projection de la caméra est ensuite utilisée pour projeter l’empreinte de l’immeuble en supposant le niveau du sol. Ensuite, on augmente progressivement l’empreinte de l’immeuble jusqu’à ce qu’elle soit alignée avec la ligne du toit du bâtiment. La hauteur du bâtiment est alors estimée comme étant l’augmentation de l’élévation.

Dans (Zhao et coll., 2019), un algorithme d’estimation de la hauteur des bâtiments est proposé. Dans cet algorithme, une image prise à partir de la rue est prétraitée. Premièrement, la segmentation sémantique est appliquée sur l’image pour la reconnaissance de bâtiments. Par la suite, la forêt structurée (Dollar et coll., 2013) (une approche d’apprentissage automatique pour la détection des contours) est utilisée dans le calcul des croquis des bâtiments. À partir des images de croquis en niveaux de gris, on identifie la ligne du toit du bâtiment et on estime la hauteur au moyen de la projection de la caméra.

Le présent article propose un algorithme appelé EHBPC d’estimation de la hauteur des immeubles, qui utilise des images de Google Street View et des empreintes d’immeubles qu’on peut obtenir par différentes sources (p. ex. Open Street Map (OSM) (OpenStreetMap, 2004) ou BDOI (Statistique Canada, 2019a)). L’algorithme proposé ressemble au dernier algorithme mentionné ci-dessus dans le sens où il utilise la segmentation sémantique et la détection de la ligne du toit pour estimer la hauteur des bâtiments. Cependant, l’algorithme EHBPC élimine la nécessité de recourir à l’apprentissage automatique pour détecter les contours. L’algorithme proposé exécute une série d’algorithmes de traitement d’image sur l’image segmentée sémantiquement pour extraire la ligne du toit du bâtiment. Ces méthodes comprennent l’extraction de composante connectée, l’approximation et l’extraction des contours, ainsi que d’autres algorithmes proposés.

L’algorithme proposé est entièrement mis en œuvre avec Python, ce qui permet de le rendre disponible en tant que cadre ouvert d’estimation de la hauteur des bâtiments. Un RNC a été utilisé pour la segmentation sémantique de l’image d’entrée. Dans les sections suivantes, l’algorithme proposé est examiné plus en détail et certains des résultats obtenus sont présentés.

3 Estimation de la hauteur des bâtiments au moyen de l’algorithme EHBPC

La présente section donne une vue d’ensemble de la façon dont la hauteur des bâtiments est estimée au moyen d’EHBPC. Par la suite, l’extraction des dimensions de bâtiments dans l’image est expliquée plus en détail.

3.1 Vue d’ensemble de l’algorithme EHBPC

La figure 1 illustre le processus d’extraction de hauteur des bâtiments au moyen d’EHBPC. Tout d’abord, une image prise à partir de la rue de l’immeuble d’intérêt est téléchargée. L’API Google Street View Static sert à obtenir des images d’essai. L’API Street View Static de Google permet de télécharger un panorama ou une vignette de Street View statique (non interactif) avec des requêtes HTTP (Google, 2020). On peut lancer une requête HTTP pour demander une image dans Street View et une image statique est renvoyée en réponse. Plusieurs paramètres peuvent être fournis dans la requête, comme l'inclinaison de la caméra et l’angle de vue. Après avoir obtenu l’image, on applique une segmentation sémantique basée sur l’AP pour identifier le bâtiment de l’image.

Ensuite, on met en œuvre une série d’étapes de traitement d’image pour extraire la hauteur du bâtiment de l’image. On obtient ainsi les données sur l’empreinte du bâtiment. Dans la mise en œuvre actuelle, nous obtenons ces données d’OSM au moyen de requêtes HTTP. À cette fin, plusieurs API disponibles (p. ex. Nominatim et OSMPythonTools) sont utilisées. Dans les travaux à venir, nous mettrons à jour le système pour obtenir ces données de la BDOI de Statistique Canada (Statistique Canada, 2019a). Après avoir obtenu toutes les données nécessaires sur l’empreinte de l’immeuble, on effectue des calculs sur les données et l’emplacement de la caméra (obtenus à partir d’un métafichier téléchargé avec l’image prise à partir de la rue) pour estimer la distance entre la caméra et le bâtiment. Enfin, on estime la hauteur du bâtiment en utilisant toutes les valeurs obtenues aux étapes précédentes dans le modèle de projection de la caméra. Ces étapes sont expliquées plus en détail dans les sections suivantes.

Figure 1

Illustration générale du flux de travail de l’algorithme EHBPC

Description de la figure 1

L’organigramme de la figure illustre le fonctionnement général de l’algorithme EHBPC. L’organigramme comprend six boîtes. La première boîte contient le texte « Téléchargement de l’image à partir de l’API Google Stree View Static ». La deuxième boîte contient le texte « Identification de bâtiments au moyen de la segmentation sémantique basée sur l’apprentissage profond ». La troisième boîte contient le texte « Traitement de l’image pour extraire les dimensions du bâtiment dans l’image ». La quatrième boîte contient le texte « Téléchargement des données sur l’empreinte du bâtiment ». La cinquième boîte contient le texte « Calcul de la distance du bâtiment dans l’image ». La sixième boîte contient le texte « Estimation de la hauteur du bâtiment ».

3.2 Extraction des dimensions du bâtiment de l’image

Nous examinerons ici les processus d’extraction des dimensions du bâtiment dans l’image. Les sections suivantes expliqueront l’acquisition des renseignements géospatiaux nécessaires, ainsi que leur déploiement aux fins d’estimation de la hauteur des bâtiments.

Figure 2

Extraction des dimensions du bâtiment de l’image

Description de la figure 2

: L’organigramme de la figure illustre le processus d’extraction des dimensions du bâtiment dans l’image. L’organigramme comprend huit boîtes. La première boîte contient le texte « Identification de bâtiments au moyen de la segmentation sémantique basée sur l’apprentissage profond ». La deuxième boîte contient le texte « Application du seuillage d’image pour l’obtention des pixels du bâtiment dans l’image ». La troisième boîte contient le texte « Extraction de la plus grande composante connectée de l’image ». La quatrième boîte contient le texte « Extraction du contour ». La cinquième boîte contient le texte « Obtention du contour approximatif ». La sixième boîte contient le texte « Obtention des points les plus élevés du contour approximatif ». La septième boîte contient le texte « Détection de la ligne la plus basse du bâtiment ». La huitième boîte contient le texte « Calcul de la hauteur approximative du bâtiment dans l’image ».

Les mesures du bâtiment dans l’image sont nécessaires à l’estimation de la hauteur réelle du bâtiment. Pour cela, il faut détecter le bâtiment dans l’image. La figure 2 illustre le processus d’extraction de la hauteur de la représentation du bâtiment dans l’image au moyen d’EHBPC. Comme le montre la figure, le processus commence par l’application d’une segmentation sémantique visant à identifier le bâtiment dans l’image. La segmentation d’image divise une image en plusieurs segments (Gonzalez et coll., 2017). Cette technique est couramment employée dans le traitement d’image, car elle simplifie l’analyse et permet d’extraire certains renseignements. Le regroupement de pixels se fait en fonction de caractéristiques spécifiques comme l’intensité, la couleur ou la connectivité des pixels.

La segmentation sémantique est un type spécial de segmentation d’image (Mottaghi et coll., 2014). Dans la segmentation sémantique, une classe est attribuée à chaque pixel de l’image d’entrée. Il s'agit donc d’un problème de classification. Cela diffère de la classification d’image dans laquelle une étiquette est attribuée à toute l’image. La segmentation sémantique vise à diviser l’image en parties significatives et à associer chaque pixel d’une image d’entrée à une étiquette de classe. Par exemple, dans notre cas, elle peut servir à diviser les pixels de l’image en différentes classes (p. ex. bâtiment, ciel ou piéton). Les véhicules autonomes sont une application très courante de la segmentation sémantique. De nos jours, les réseaux neuronaux profonds servent généralement à résoudre les problèmes de segmentation sémantique. En particulier, les RNC donnent de très bons résultats à la fois exacts et efficaces. Les RNC constituent une classe de réseaux neuronaux profonds, le plus souvent appliqués à l’analyse de l’imagerie visuelle. Un RNC se compose de couches d’entrée et de sortie, ainsi que de plusieurs couches cachées. En général, les couches cachées des RNC consistent en une série de couches convolutives qui convoluent avec une multiplication ou un autre produit scalaire. Un RNC TensorFlow est utilisé pour la segmentation sémantique des images prises à partir de la rue (Chen et coll., 2018). L’architecture employée (xception-71) (Chen et coll., 2018) est une version perfectionnée du modèle Xception d’origine (Chollet, 2017) avec les améliorations suivantes : (1) davantage de couches, (2) toutes les opérations de max-agrégation (max-pooling) sont remplacées par une convolution séparable en profondeur avec un pas (ce qui permet l’application d'une convolution séparable à trous pour l’extraction de cartes de caractéristiques à une résolution arbitraire), et (3) normalisation par lot et ReLU (Rectified Linear Unit) supplémentaires après chaque ajout de convolution d’une profondeur de 3 x 3 (Chen et coll., 2018).

L’architecture d’origine de Xception (qui signifie « Extreme Inception ») (Chollet, 2017) est entièrement basée sur des couches de convolution séparables en profondeur. Il s’agit d’un empilement linéaire de couches de convolution séparables en profondeur avec des connexions résiduelles. Cela simplifie la définition et la modification de l’architecture. Parce que des résultats de classification d’image prometteurs avec des calculs rapides ont été obtenus au moyen de ce modèle sur ImageNet, elle a été adoptée aux fins de segmentation sémantique dans (Chen et coll., 2018). On a adopté ici le modèle de (Chen et coll., 2018) après avoir testé plusieurs architectures de segmentation sémantique et constaté qu’il donnait les résultats de segmentation les meilleurs et les plus fiables. Notons que le modèle choisi a été entraîné sur des images de villes européennes (ensemble de données Cityscapes) et que nous cherchons à réaliser un apprentissage par transfert. D'après les résultats de la mise à l’essai du modèle sur de nombreuses images d’immeubles de la ville d’Ottawa (Canada), il semblerait que les caractéristiques apprises sur les immeubles des villes européennes fonctionnent correctement sur les immeubles d’Ottawa.

Après téléchargement de l’image à l’aide d’un client Python, elle vient alimenter le RNC. La sortie est une image segmentée sémantiquement dont les pixels portent les étiquettes de plusieurs classes (p. ex. ciel, bâtiment ou rue). La figure 3 montre un exemple d’image d’un immeuble commercial à Ottawa (Canada) téléchargée avec le client Python à partir de l’API Google Street View Static au moyen d’une requête HTTP. La figure 4 montre la sortie du RCN, qui est une image segmentée sémantiquement.

Description de la figure 3

La figure donne un exemple d’image d’essai d’un immeuble commercial à Ottawa (Ontario), au Canada.

Comme le montre la figure 4, le bâtiment apparaît sous forme de sous-régions vertes dans l’image de sortie. En raison des imperfections du RNC, il peut y avoir d’autres petites sous-régions vertes dans l’image, comme le montre la figure 4. On applique ensuite un seuillage à l’image de la figure 4 pour extraire uniquement les pixels qui représentent le bâtiment. L’image de sortie du seuillage est une image binaire, comportant des pixels blancs (pixels du bâtiment) sur fond noir. Comme on l’a dit précédemment, l’image peut contenir d’autres petites sous-régions. Cela peut s’expliquer par une segmentation sémantique imparfaite ou la présence d’un autre bâtiment éloigné en arrière-plan. Pour éliminer ces sous-régions non liées, le plus grand composant connecté de l’image est extrait. Le résultat de cette étape est une région blanche dans l’image (le bâtiment), superposée sur un fond noir, comme le montre la figure 5.

L’étape suivante consisterait à extraire la frontière du bâtiment. À cette fin, le contour de l’avant-plan de l’image (le bâtiment) est extrait. Les contours sont simplement une courbe reliant les points continus (le long de la frontière) d’une forme dans l’image. Les contours sont très utilisés et utiles dans l’analyse des formes et la détection et la reconnaissance d’objets.

Description de la figure 4

La figure montre l’image de sortie du réseau neuronal convolutif, à l’aide de l’image de la figure 3 comme entrée. L’image de sortie du réseau neuronal convolutif est l’image segmentée sémantiquement. L’image est divisée en nombreuses sous-régions, où chaque sous-région appartient à une catégorie précise (p. ex. bâtiment, route, végétation, etc.) représentée par une couleur unique. Le bâtiment apparaît sous forme de sous-région verte dans l’image. Les sous-régions de végétation apparaissent en violet. La route apparaît sous forme de sous-région noire dans l’image.

Description de la figure 5

La figure représente une image binaire qui est la sortie du seuillage d’image et de l’extraction de composante connectée, à l’aide de l’image de la figure 4 comme entrée. L’image de la figure est une image en noir et blanc où la zone blanche correspond aux pixels qui représentent le bâtiment.

Description de la figure 6

La figure montre l’image segmentée sémantiquement (la sortie du réseau neuronal convolutif) dans laquelle les deux points supérieurs du contour sont en superposition.

L’objectif ici est d’extraire la ligne supérieure du bâtiment de l’image. C’est pourquoi le contour extrait est approximatif. Au lieu d’avoir un contour composé de nombreux points le long de la frontière de l'avant-plan/du bâtiment, on génère un contour approximatif contenant les principaux coins de l’avant-plan. Il est possible de régler le degré d’approximation du contour. Après extraction du contour approximatif du bâtiment dans l’image, les deux points supérieurs du contour approximatif sont extraits. Ces deux points donnent la ligne du toit du bâtiment sur l’image. La figure 6 montre les points supérieurs extraits du contour approximatif du bâtiment superposé sur le bâtiment dans l’image segmentée sémantiquement.

Comme nous l’expliquerons plus loin, le point le plus bas du bâtiment qui se trouve sur ou au-dessus de la ligne médiane horizontale de l’image doit être détecté. À cette fin, on propose et met en œuvre un algorithme simple, qui balaye l’image, à partir de la ligne médiane horizontale à la recherche des pixels de la composante connectée. Quand l'algorithme le trouve, la hauteur du bâtiment dans l’image est considérée comme étant la hauteur à partir de la ligne la plus basse contenant un pixel de composante connectée, jusqu’à la ligne du toit.

La figure 6 et la figure 7 montrent les résultats obtenus pour les mêmes étapes avec un immeuble résidentiel à Ottawa (Ontario, Canada).

Description de la figure 7

(a) La figure donne un exemple d’image d’essai d’un immeuble résidentiel à Ottawa (Ontario), au Canada. (b) La figure montre l’image de sortie du réseau neuronal convolutif, à l’aide de l’image de la figure 7 comme entrée. L’image de la figure 7-b est divisée en nombreuses sous-régions, où chaque sous-région appartient à une catégorie précise (p. ex. bâtiment, route, végétation, etc.) représentée par une couleur unique. Le bâtiment apparaît sous forme de sous-région verte dans l’image. Les sous-régions de végétation apparaissent en violet. La route apparaît sous forme de sous-région noire dans l’image.

Description de la figure 8

(a) La figure représente une image binaire qui est la sortie du seuillage d’image et de l’extraction de composante connectée, avec l’image de la figure 7-b comme entrée. L’image de la figure 8-a est une image en noir et blanc où la zone blanche correspond aux pixels qui représentent le bâtiment. (b) La figure montre l’image segmentée sémantiquement (la sortie du réseau neuronal convolutif) dans laquelle les deux points supérieurs du contour sont en superposition.

4 Utilisation des données sur l’empreinte d’immeuble

En plus de l’identification du bâtiment et de l’extraction de ses dimensions dans l’image, nous devons déterminer l’emplacement du bâtiment et de la caméra et calculer la distance entre les deux. Le modèle de projection de la caméra a besoin de cette mesure pour estimer la hauteur du bâtiment. On utilise OSM (OpenStreetMap, 2004; Wikipedia, 2004) pour obtenir des renseignements sur l’emplacement de l’immeuble. OSM est une plateforme qui fournit une carte du monde modifiable et gratuite. Elle permet de nombreux cas d’utilisation comme la génération de cartes, le géocodage des adresses et des noms de lieux, et la planification d’itinéraires (OpenStreetMap, 2004; Wikipedia, 2004).

Dans notre cas, OSM est utilisé premièrement à des fins de géocodage, c’est-à-dire pour l’obtention de la latitude et la longitude d’un texte d’entrée, comme une adresse ou le nom d’un lieu, et le géocodage inversé, c’est-à-dire la conversion de coordonnées géographiques en la description d’un lieu, habituellement le nom d’un lieu ou d’un endroit adressable. Deuxièmement, OSM est utilisé pour l'obtention d’empreintes d’immeubles, qui comprennent diverses données spatiales sur l’immeuble d’intérêt. Dans les travaux à venir, nous mettrons à jour le système pour tirer ces données de la BDOI de Statistique Canada (Statistique Canada, 2019a). SI les données sont disponibles localement, le fonctionnement du système est plus rapide.

Nominatim est un outil de recherche de données OSM par nom et adresse (géocodage) et de génération d’adresses de points OSM (géocodage inversé). On utilise Python pour accéder à cette API au moyen de requêtes HTTP. Tout d'abord, on demande l’emplacement de l’immeuble. L’objet de l’emplacement renvoyé contient plusieurs éléments d’information comme la latitude, la longitude, le type d’enregistrement (chemin, nœud, etc.) et l’identifiant OSM de l’enregistrement. On utilise ensuite l’API OSMPythonTools pour obtenir l’empreinte du bâtiment à l’aide de l’identifiant OSM.

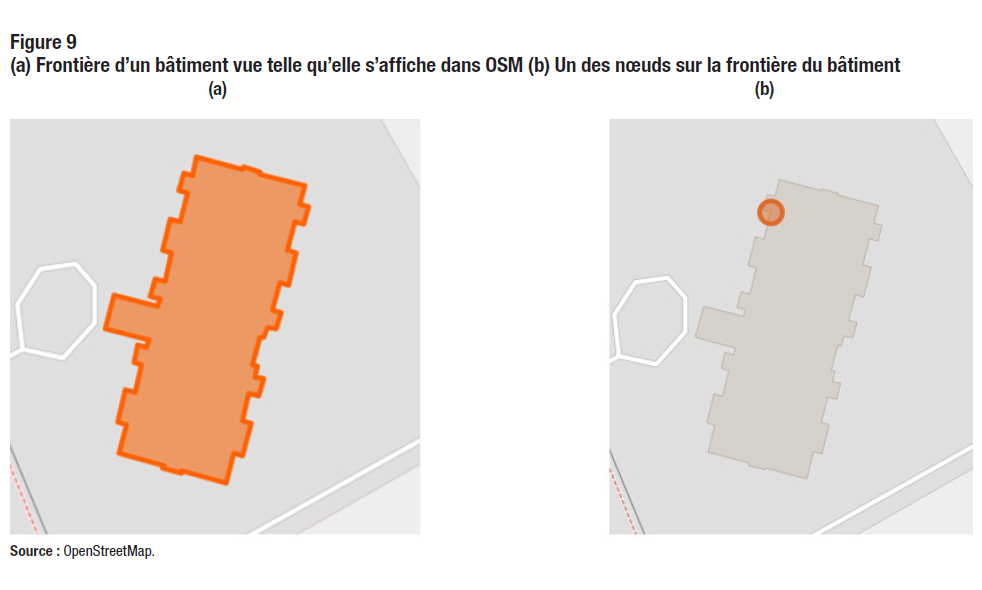

Description de la figure 9

(a) Cette figure montre une capture d’écran du plan d’un bâtiment et de sa frontière, comme ils apparaissent dans OpenStreetMap (b) La figure montre le plan d'un bâtiment avec l’un des nœuds de l’immeuble en surbrillance.

L’empreinte du bâtiment comprend des données importantes comme la latitude et la longitude du centre du bâtiment, ainsi que la latitude et la longitude de différents nœuds du bâtiment, c’est-à-dire de divers points sur la frontière du bâtiment, comme on le voit à la figure 9. Une fois les nœuds du bâtiment obtenus, la liste de ces nœuds est établie et le bâtiment est traité comme un polygone. Ensuite, on interroge un fichier de métadonnées téléchargé à partir de l’API Google Street View avec la requête d’image pour obtenir l’emplacement de la caméra; après cette étape, la distance entre la caméra et l’immeuble est calculée.

5 Modèle de projection de la caméra

Un modèle de projection de la caméra précise mathématiquement la relation entre les coordonnées d’un point dans un espace tridimensionnel et sa projection sur un autre plan. Il sert à modéliser la géométrie de projection des points, courbes et surfaces 3D sur une surface bidimensionnelle (par exemple, plan de vue, plan d’image, etc.). Après extraction de tous les renseignements ci-dessus, le modèle de projection de la caméra est utilisé pour estimer la hauteur réelle du bâtiment. Le même modèle de projection de la caméra que celui de (Zhao et coll., 2019) est employé ici. Dans la présente section, on expliquera brièvement le modèle de projection de la caméra utilisé pour l’estimation de la hauteur du bâtiment.

Commençons par définir deux systèmes de coordonnées. Le premier est le système de coordonnées de la caméra, désigné par , où indique le point d’origine du système.

Le second système est le système de coordonnées du plan d’image, désigné par, où indique le point d’origine du système. Les deux systèmes sont illustrés à la figure 10.

Figure 10

Illustration du modèle de projection de la caméra

Description de la figure 10

La figure illustre le modèle de projection de la caméra. La figure montre un prisme rectangulaire qui représente le bâtiment. La caméra est placée à une distance du bâtiment. Un système de coordonnées tridimensionnel qui représente le système de coordonnées de la caméra est illustré au-dessus de la caméra. Derrière la caméra figure un plan bidimensionnel qui représente le plan image, sur lequel est superposé un système de coordonnées bidimensionnel. La hauteur du bâtiment de l’image dans le plan image, , est utilisée en combinaison avec la distance, et d’autres paramètres dans le modèle de projection de la caméra pour estimer la hauteur du bâtiment .

Comme on le voit dans la figure, est la hauteur réelle du bâtiment. Soit la hauteur estimée du bâtiment, et est la distance entre la caméra et le bâtiment. De plus, supposons que désigne la hauteur de la caméra, c’est-à-dire la hauteur de la personne tenant la caméra ou la hauteur de la voiture sur laquelle la caméra est montée (on peut supposer qu’elle est constante). Dans ce cas, la hauteur estimée du bâtiment peut être notée comme suit :

où est la hauteur de l'image de bâtiment au-dessus de la ligne horizontale médiane de l’image, et est la distance focale de la caméra.

6 Résultats

6.1 Résultats obtenus et analyse

Dans la présente section, certains des résultats obtenus à partir du système élaboré aux fins d’estimation de la hauteur des bâtiments sont présentés et analysés. Le système élaboré a été mis à l’essai sur différents bâtiments (commerciaux et résidentiels) de la ville d’Ottawa (Canada). Un ensemble aléatoire de 20 bâtiments a été examiné. La hauteur minimale dans l’ensemble est de 4 m et la hauteur maximale de 54 m. Plus de 50 % des bâtiments de l’ensemble ont une hauteur supérieure à 14 m. Toutes les images ont été téléchargées à une résolution spatiale de 640 x 640. Le système a été alimenté avec des images sans recadrage ni augmentation. Dans la section, nous présentons des échantillons des résultats obtenus. En outre, nous analysons les résultats obtenus et évaluons le rendement du système pour ce qui est des erreurs d’estimation (à partir de l’ensemble de données d’Ottawa).

Description de la figure 11

La figure montre l’image d’un bâtiment commercial d’Ottawa (Canada) dont la hauteur estimée est mise en surimpression sur l’image.

La figure 11 montre le résultat obtenu pour un immeuble commercial situé à Ottawa (Canada). Le résultat est tracé par-dessus le bâtiment comme le montre la figure. On constate que la hauteur estimée du bâtiment est de 22,83 m et que sa hauteur réelle est d’environ 20 m.

Description de la figure 12

La figure montre deux images de bâtiments résidentiels à Ottawa (Canada), dont la hauteur estimée respective est superposée sur l’image du bâtiment.

La figure 12 montre les résultats obtenus pour deux bâtiments résidentiels différents d’Ottawa (Canada). La hauteur réelle du bâtiment de la figure 12-a est de 45 m. Or la figure indique que le résultat obtenu pour ce bâtiment est de 48,052 m. Pour ce qui est du bâtiment de la figure 12-b, la hauteur réelle est de 42 m, et la figure indique que la hauteur estimée est de 44,044 m.

Comme cela a été mentionné, le système élaboré a été mis à l’essai sur différents bâtiments (commerciaux et résidentiels) de la ville d’Ottawa (Canada). Un ensemble aléatoire de 20 bâtiments a été examiné. La hauteur du bâtiment a été estimée pour tous les bâtiments de l’échantillon et l’erreur d’estimation a été calculée. L’erreur d’estimation moyenne pour tous les échantillons est de 2,32 m.

La figure 13 montre la fonction de distribution cumulative empirique (FDCE) pour les erreurs d’estimation. La FDCE montre que 50 % des bâtiments ont une erreur d’estimation inférieure ou égale à 2 m, et que 85 % des bâtiments ont des erreurs d’estimation de 4 m ou moins.

Description de la figure 13

La figure illustre la fonction de distribution cumulative empirique des erreurs d’estimation de la hauteur du bâtiment.

6.2 Cas délicats

Des améliorations sont apportées actuellement au système afin qu'il puisse prendre en charge certains cas compliqués. Par exemple, il arrive que la végétation rende difficile la détection du bord inférieur du bâtiment, comme on le voit à la figure 14. Dans de nombreux cas, cela ne pose pas de problème, car nous avons besoin du bas du bâtiment qui se trouve sur ou au milieu de la ligne horizontale de l’image. On rencontre aussi une difficulté quand la caméra se trouve en face d’un coin de l’immeuble plutôt qu’une de ses façades.

Description de la figure 14

La figure montre une image segmentée sur le plan sémantique qui illustre comment la végétation peut masquer un bâtiment et compliquer son identification.

6.3 Extensibilité du système mis au point

L’extensibilité du système pose deux grandes préoccupations : son coût et le temps d’exécution. À l'heure actuelle, il faut environ 30 secondes pour estimer la hauteur d’un bâtiment, sur un processeur Intel i7 à quatre cœurs avec 16Go de RAM. Bien sûr, le traitement peut être accéléré au moyen d'un ordinateur plus puissant ou d'une exécution dans le nuage. À la connaissance de l’auteur, les solutions commercialisées demandent environ 7 $US pour 1 000 requêtes d’images. Ajoutons que les conditions d’utilisation de chaque plateforme peuvent différer. À titre d’exemple, nous présentons ici deux études de cas sur l’extensibilité du système : la ville de Toronto et la ville d’Ottawa. D’après (Emporis, 2000), la ville de Toronto compte 9 538 bâtiments (commerciaux, gouvernementaux, salles et stades compris). L’obtention de la hauteur de ces bâtiments au moyen du système mis au point (selon les mesures ci-dessus) nécessiterait environ 79,5 heures pour un coût approximatif de 10 $US. Selon la même source (Emporis, 2000), la ville d’Ottawa compte 935 bâtiments (commerciaux, gouvernementaux, salles et stades compris). L’obtention de la hauteur de ces bâtiments au moyen du système mis au point (selon les mesures ci-dessus) nécessiterait environ 7,8 heures pour un coût inférieur à 7 $US.

7 Conclusion

On constate un intérêt croissant pour l’extraction de renseignements importants, qui ont de nombreuses applications, à partir d’images prises à partir de la rue. Citons notamment l’exemple de leur utilisation dans la détection et la cartographie des trottoirs et des panneaux de circulation dans les villes en urbanisme. La hauteur des bâtiments est un élément d’information important qui peut être extrait des images prises à partir de la rue. Ces renseignements primordiaux ont diverses applications importantes, par exemple dans les analyses économiques et l’élaboration de cartes tridimensionnelles des villes. Dans le cadre du projet, un système à code source ouvert est mis au point afin d’estimer automatiquement la hauteur des bâtiments à partir d’images prises à partir de la rue au moyen de l’apprentissage profond (AP), de techniques avancées de traitement d’image et de données géospatiales. De nos jours, les images prises à partir de la rue et les données géospatiales nécessaires sont omniprésentes et disponibles sur de nombreuses plateformes. Le système a été conçu afin de servir à enrichir la Base de données ouvertes sur les immeubles (BDOI), qui a été publiée par Statistique Canada, dans le cadre de l'Environnement de couplage de données ouvertes (ECDO). Le système mis au point a été mis à l’essai sur un groupe d’immeubles résidentiels et commerciaux de la ville canadienne d’Ottawa. Les résultats montrent qu’il peut servir à estimer avec exactitude la hauteur des bâtiments. De plus, l’analyse de l’extensibilité montre que le système peut aussi estimer la hauteur des bâtiments à une plus grande échelle (p. ex. à l’échelle d’une grande ville ou d’un pays). Les améliorations apportées actuellement au système lui permettront de traiter plus de cas (p. ex. traitement d’images prises avec un angle d’élévation élevé de la caméra, sélection automatique de l’angle d’élévation de la caméra, etc.). En outre, d’autres essais seront réalisés afin d’évaluer le rendement du système avec des ensembles de données plus grands et des images provenant de différentes zones (p. ex. grandes villes avec des secteurs plus denses).

References

Brunner, D., Lemoine, G., Bruzzone, L., & Greidanus, H. (2010). Building height retrieval from VHR SAR imagery based on an iterative simulation and matching technique. IEEE Transactions on Geoscience and Remote Sensing, 48(3 PART2), 1487–1504.

Chen, L.-C., Zhu, Y., Papandreou, G., Schroff, F., & Adam, H. (2018). Encoder-decoder with atrous separable convolution for semantic image segmentation. European Conference on Computer Vision, 833–851.

Chollet, F. (2017). Xception: Deep learning with depthwise separable convolutions. Proceedings - 30th IEEE Conference on Computer Vision and Pattern Recognition, CVPR 2017, 1800–1807.

Díaz, E., & Arguello, H. (2016). An algorithm to estimate building heights from Google street-view imagery using single view metrology across a representational state transfer system. Dimensional Optical Metrology and Inspection for Practical Applications V, 1–8.

Dollar, P., & Zitnick, C. L. (2013). Structured forests for fast edge detection. Proceedings of the IEEE International Conference on Computer Vision, 1841–1848.

Emporis. (2000). EMPORIS. Retrieved from https://www.emporis.com/

Gebru, T., Krause, J., Wang, Y., Chen, D., Deng, J., Aiden, E. L., & Fei-Fei, L. (2017). Using deep learning and google street view to estimate the demographic makeup of neighborhoods across the United States. Proceedings of the National Academy of Sciences of the United States of America, 114(50), 13108–13113

Gonzalez, R., & Woods, R. (2017). Digital image processing (4th ed.). Pearson.

Google. (2020). Street View Static API. Retrieved from https://developers.google.com/maps/documentation/streetview/intro

Grab Holdings. (2009). Open Street Cam. Retrieved from https://openstreetcam.org/map/@45.37744755572422,-75.65142697038783,18z

Kang, J., Körner, M., Wang, Y., Taubenböck, H., & Zhu, X. X. (2018). Building instance classification using street view images. ISPRS Journal of Photogrammetry and Remote Sensing, 145, 44–59.

Lichao Mou, X. X. Z. (2018). IM2HEIGHT: Height estimation from single monocular imagery via fully residual convolutional-deconvolutional network. ArXiv Preprint, ArXiv:1802.10249

Mapillary. (2014). Mapillary. Retrieved from https://www.mapillary.com/

Mottaghi, R., Chen, X., Liu, X., Cho, N. G., Lee, S. W., Fidler, S., Urtasun, R., & Yuille, A. (2014). The role of context for object detection and semantic segmentation in the wild. Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 891–898.

OpenStreetMap. (2004). OpenStreetMap. Retrieved from https://www.openstreetmap.org/#map=4/30.56/-64.16

Sampath, A., & Shan, J. (2010). Segmentation and reconstruction of polyhedral building roofs from aerial lidar point clouds. IEEE Transactions on Geoscience and Remote Sensing, 48(3 PART2), 1554–1567.

Smith, V., Malik, J., & Culler, D. (2013). Classification of sidewalks in street view images. 2013 International Green Computing Conference Proceedings, IGCC 2013, 1–6.

Statistics Canada. (2019a). Open Database of Buildings. Retrieved from https://www.statcan.gc.ca/eng/lode/databases/odb

Statistics Canada. (2019b). The Linkable Open Data Environment. Retrieved from https://www.statcan.gc.ca/eng/lode

Wikipedia. (2004). OpenStreetMap. Retrieved from https://en.wikipedia.org/wiki/OpenStreetMap

Yuan, J., & Cheriyadat, A. M. (2016). Combining maps and street level images for building height and facade estimation. Proceedings of the 2nd ACM SIGSPATIAL Workshop on Smart Cities and Urban Analytics, UrbanGIS 2016, 1–8.

Zhao, Y., Qi, J., & Zhang, R. (2019). CBHE: Corner-based building height estimation for complex street scene images. Proceedings of the World Wide Web Conference, 2436–2447.

- Date de modification :